AI 에이전트 하네스, AWS AgentCore로 배포 단순화

이번 주 에이전트 하네스 엔지니어링 분야 최대 뉴스는 AWS가 Amazon Bedrock AgentCore를 통해 AI 에이전트 배포를 단 3개의 API 호출로 압축한 업데이트를 발표한 것. 새로운 CLI, 퍼시스턴트 파일시스템, 스킬 레이어가 추가되면서 배포 진입장벽이 크게 낮아졌다. 동시에 멀티 에이전트 시스템 평가와 안전 가드레일에 관한 arXiv 논문들(AgentDoG, Beyond Task Success)이 주목받고 있으며, 오픈소스 커뮤니티에서는 awesome-harness-engineering 같은 실전 중심 리포지토리가 빠르게 성장 중이다. AgentOps 기반 다중 환경 배포 전략과 CrewAI→LangGraph 마이그레이션 사례에서 얻은 토큰 효율성 개선 노하우도 주목할 만하다.

AI 에이전트 하네스, AWS AgentCore로 배포 단순화

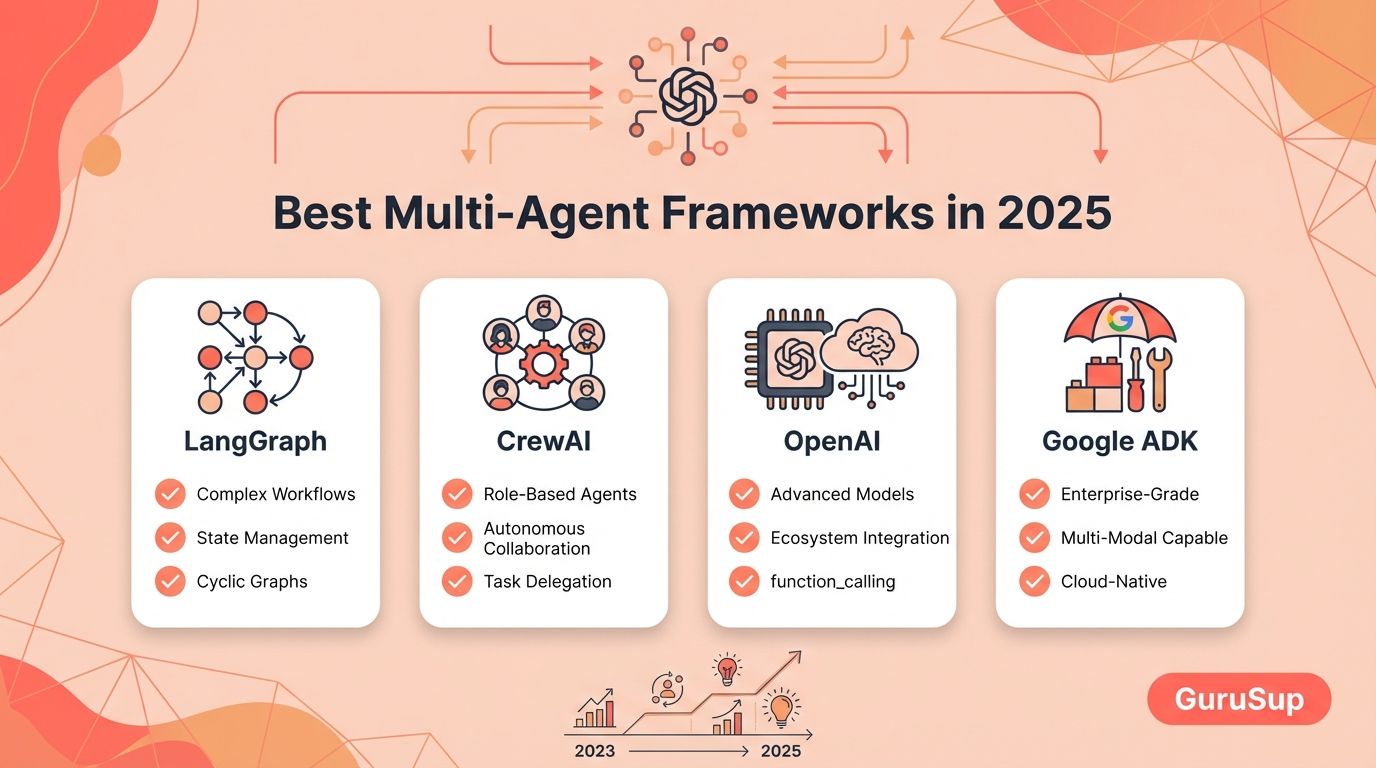

Scope note: This report covers AI Agent Harness Engineering — the software scaffolding, orchestration frameworks (LangGraph, DSPy, CrewAI, AutoGen, Claude Agent SDK, OpenAI Agents SDK), tool-use patterns, guardrails, memory systems, and evaluation infrastructure for production LLM agents. It is NOT about physical wire harnesses, cabling, or automotive electrical systems.

This Week's Headlines

- AWS, Amazon Bedrock AgentCore로 에이전트 셋업을 3개 API 호출로 단축 — 신규 CLI, 퍼시스턴트 파일시스템, 스킬 카탈로그가 추가되면서 자율 AI 에이전트 배포의 복잡성이 획기적으로 감소했다.

- AgentDoG: 에이전트 안전·보안 진단용 가드레일 프레임워크 arXiv 공개 — ATBench 벤치마크를 통해 LlamaGuard, GPT-5.2, Qwen3 등 주요 가드 모델들을 비교 평가하면서 실행 전 단계 리스크 분류를 제안했다.

- "Task Success를 넘어서": 에이전트 AI 평가·거버넌스·오케스트레이션 증거 합성 프레임워크 — 24개 소스를 분석한 arXiv 논문으로, 런타임 거버넌스와 가드레일 인증을 포괄하는 통합 평가 방법론을 제시한다.

- Belitsoft, AgentOps 활용 다중 환경 에이전트 배포 전략 공개 — PwC 2025 AI 에이전트 서베이에서 79%의 기업이 이미 프로덕션 에이전트를 운영하는 상황에서 실전 배포 인사이트를 분석했다.

Framework & Tooling Updates

Amazon Bedrock AgentCore — 관리형 에이전트 하네스 대규모 업데이트

- What's new: 자율 AI 에이전트를 단 3개의 API 호출로 배포할 수 있는 관리형 하네스 레이어 도입. 신규 CLI 도구, 퍼시스턴트 파일시스템, 에이전트 스킬 카탈로그가 함께 추가되었다.

- Why it matters: 기존에는 에이전트 인프라 셋업에 수십 줄의 코드와 복잡한 IAM 설정이 필요했던 것을 극적으로 단순화한다. 퍼시스턴트 파일시스템은 장기 실행 에이전트의 상태 유지 문제를, 스킬 레이어는 도구 등록 반복 작업을 해결해 운영 오버헤드를 크게 줄인다. 에이전트 하네스 엔지니어링의 "인프라 추상화" 흐름을 클라우드 벤더가 직접 수용한 첫 대규모 사례로 평가된다.

- Migration notes: 기존 Bedrock 에이전트 사용자는 AgentCore SDK 신규 버전을 적용해야 하며, 퍼시스턴트 파일시스템 사용 시 기존 상태 관리 코드와 충돌 여부를 사전 검토 필요.

Research & Evaluation

AgentDoG: 에이전트 안전·보안을 위한 진단용 가드레일 프레임워크

- Authors / Org: arXiv (arxiv.org/html/2601.18491), 공개 5일 전

- Core finding: ATBench 벤치마크에서 리스크 소스 정확도, 실패 모드 정확도, 실세계 피해 정확도를 세밀하게 레이블링하여 LlamaGuard3-8B, LlamaGuard4-12B, Qwen3-Guard, ShieldAgent, GPT-5.2, Qwen3-235B-A22B 등 주요 가드 모델 및 범용 모델과 비교 평가했다. 사전 실행(pre-exec) 단계에서의 리스크 탐지에 초점을 맞추어 에이전트 실행 전 위험 필터링 효율을 크게 높였다.

- Implication for harness design: 프로덕션 에이전트 하네스에 Pre-Exec 가드레일 레이어를 별도로 구성하고, 단순 텍스트 분류를 넘어 리스크 소스·실패 모드 분류까지 포함하는 다층 안전 아키텍처를 도입해야 함을 시사한다.

Beyond Task Success: 에이전트 AI 평가·거버넌스·오케스트레이션 증거 합성 프레임워크

- Authors / Org: arXiv (arxiv.org/html/2604.19818), 약 1주 전 공개

- Core finding: arXiv, ACL Anthology, NIST, ISO 등에서 수집한 24개 소스를 분석해 태스크 성공률만 보는 기존 평가 방식의 한계를 지적하고, 런타임 거버넌스·오케스트레이션 정책 집행·도구 안전성·가드레일 인증까지 포괄하는 통합 평가 프레임워크를 제안한다. Stanford HAI의 2026 AI Index를 역량 추적 앵커로 활용했다.

- Implication for harness design: 에이전트 평가 인프라를 설계할 때 단순 성공/실패 이진 지표에서 벗어나, 거버넌스 정책 준수 여부와 도구 호출 안전성을 독립 측정 축으로 추가해야 한다. 특히 멀티 에이전트 오케스트레이션 시 각 에이전트 간 정책 집행 일관성을 별도 검증할 것을 권장한다.

AgentDoG Pre-Exec Bench — 사전 실행 가드레일 벤치마크

- Authors / Org: arXiv (arxiv.org/html/2510.09781v1) — 참고: 이 벤치마크는 상기 AgentDoG 프레임워크에서 평가 기준으로 활용됨

- Core finding: Pre-Exec Bench는 무해 샘플 1,001개와 위험 샘플 671개(주입된 리스크 포함)로 구성되며, 가드레일 모델의 훈련 및 모델 선택에서 완전히 분리하여 공정한 평가를 보장한다.

- Implication for harness design: 에이전트 하네스에서 도구 호출 전 단계의 가드레일 성능을 독립적으로 측정하는 벤치마크 데이터셋을 확보하는 것이 중요하며, AgentDoG의 Pre-Exec Bench는 이 용도로 즉시 활용 가능하다.

Production Patterns & Practitioner Insights

AgentOps 기반 다중 환경 에이전트 배포 전략

- Context: PwC 2025 AI 에이전트 서베이에서 79%의 기업이 이미 프로덕션 에이전트를 운영 중인 환경에서, Belitsoft가 AgentOps 플랫폼을 활용한 다중 환경(개발/스테이징/프로덕션) 배포 전략을 리뷰했다.

- Problem: 단일 환경에서는 잘 동작하던 에이전트가 환경 전환 시 도구 호출 실패, 컨텍스트 불일치, 비용 폭증 등의 문제를 겪는 사례가 빈번하다.

- Solution / Takeaway: AgentOps를 하네스의 관찰 가능성 레이어로 삽입하면 에이전트 실행 트레이스, 토큰 비용, 재시도 패턴을 환경별로 분리 추적할 수 있다. 특히 환경 간 도구 스키마 버전 관리와 퍼미션 수준 차등화가 핵심이며, 환경별 독립된 평가 기준을 사전 정의해야 롤백 판단 기준이 명확해진다.

CrewAI → LangGraph 마이그레이션: 토큰 18% 절감 사례

- Context: 월 $10,000 이상의 LLM API 비용을 지출하는 팀이 CrewAI에서 LangGraph로 프레임워크를 전환한 실전 경험을 공개했다.

- Problem: CrewAI의 추상화 레이어가 LangGraph 대비 약 18%의 토큰 오버헤드를 발생시켜, 같은 워크플로우 대비 월 약 $1,800의 추가 비용이 발생했다.

- Solution / Takeaway: 타입화된 상태 스키마와 MCP 도구 패턴을 활용한 단계별 마이그레이션 가이드를 통해 오버헤드를 제거했다. 프레임워크 선택은 단순 기능 비교를 넘어 토큰 효율성을 핵심 지표로 포함해야 하며, 대규모 배포 전 반드시 토큰 프로파일링을 선행할 것을 권장한다.

Trending OSS Repositories

- ai-boost/awesome-harness-engineering — 에이전트 하네스 엔지니어링 전반(도구, 패턴, 평가, 메모리, MCP, 퍼미션, 관찰 가능성, 오케스트레이션)을 망라한 큐레이션 리스트. "에이전트가 자신의 하네스를 스스로 수정하는 메타-하네스" 패턴까지 포함, 2일 전 공개.

- VoltAgent/awesome-ai-agent-papers — 2026년 발표된 에이전트 엔지니어링, 메모리, 평가, 워크플로우, 자율 시스템 관련 연구 논문 큐레이션. 1주 전 공개되어 빠르게 주목받고 있음.

- masamasa59/ai-agent-papers — 격주 업데이트 방식의 AI 에이전트 논문 컬렉션. "터미널용 AI 코딩 에이전트 구축: 스캐폴딩, 하네스, 컨텍스트 엔지니어링, 교훈" 논문 포함.

Deep Dive: AWS AgentCore — 에이전트 하네스의 "인프라 추상화" 임계점

이번 주 가장 주목할 발전은 AWS가 Amazon Bedrock AgentCore 업데이트를 통해 AI 에이전트 배포 복잡성을 극적으로 낮춘 것이다. 기존 에이전트 배포는 IAM 역할 구성, VPC 셋업, 런타임 환경 관리, 도구 등록, 상태 저장소 연결 등 수십 단계의 인프라 작업을 수반했다. AgentCore는 이 과정을 관리형 하네스 계층으로 감싸, 실제 에이전트 로직을 담은 3개의 API 호출만으로 자율 에이전트를 배포할 수 있게 한다.

기술적으로 이번 업데이트의 핵심은 세 가지다. 첫째, 신규 CLI는 에이전트 패키징, 배포, 버전 관리를 로컬 개발 워크플로우에 통합한다. 둘째, 퍼시스턴트 파일시스템은 장기 실행 에이전트가 실행 간 상태를 유지하는 가장 큰 기술적 난제를 해결한다. 이는 Anthropic이 "harness design for long-running apps" 시리즈에서 강조해온 컨텍스트 컴팩션 문제와 직결된다. 셋째, 스킬 카탈로그는 도구 스키마를 에이전트별로 반복 정의하는 대신 중앙화된 레지스트리에서 재사용할 수 있게 한다.

하네스 아키텍처 관점에서 이 변화는 중요한 시사점을 갖는다. 기존에는 LangGraph, CrewAI, AutoGen 같은 오케스트레이션 프레임워크가 하네스의 "상위 레이어"를 담당하고, 개발자가 직접 인프라 "하위 레이어"를 관리해야 했다. AgentCore는 이 하위 레이어를 완전히 추상화함으로써, 에이전트 엔지니어가 오케스트레이션 로직과 도구 설계에 집중할 수 있는 환경을 만든다. 이는 마치 서버리스가 서버 관리를 추상화한 것처럼, "에이전트리스(agentless)" 하네스 관리의 첫 번째 구체적 사례라 볼 수 있다.

그러나 이 추상화에는 트레이드오프가 따른다. 관리형 레이어는 성능 튜닝과 세밀한 컨텍스트 제어 옵션을 제한할 수 있다. CrewAI→LangGraph 마이그레이션에서 18% 토큰 절감을 달성한 사례처럼, 추상화 레이어가 두꺼울수록 토큰 오버헤드가 커질 가능성이 있다. 또한 벤더 종속성과 멀티클라우드 이식성 문제는 AgentCore 도입 전 반드시 검토해야 할 요소다.

결론적으로, AgentCore 업데이트는 에이전트 하네스 엔지니어링이 "자체 구축" 단계에서 "관리형 추상화" 단계로 전환하는 임계점을 보여준다. 스타트업이나 소규모 팀은 즉각적인 생산성 향상을 얻을 수 있지만, 대규모 프로덕션 시스템을 운영하는 팀은 추상화 비용과 커스터마이징 한계를 신중히 평가해야 한다.

What to Watch Next Week

- AgentDoG 프레임워크 실전 적용 사례 등장 여부 — ATBench 벤치마크와 Pre-Exec 가드레일 패턴이 주요 하네스 프레임워크(LangGraph, CrewAI)에 통합되는 PR이나 예제가 나올지 주목할 것. 에이전트 안전 레이어 표준화의 분기점이 될 수 있다.

- Amazon Bedrock AgentCore 커뮤니티 피드백 및 성능 벤치마크 — 3 API 호출 배포의 실제 토큰 오버헤드와 레이턴시 프로파일이 커뮤니티에서 공유될 가능성이 높다. LangGraph 직접 구현 대비 실질적 트레이드오프가 명확해질 것.

- arXiv 2604.19818 프레임워크의 프로덕션 평가 인프라 적용 시도 — "Task Success를 넘어선" 멀티 축 에이전트 평가 프레임워크가 기존 SWE-bench, GAIA, tau-bench 평가 파이프라인과 어떻게 결합될지, 오픈소스 구현체가 등장할지 추적 필요.

Reader Action Items

- AgentCore 3-API 배포 패턴 파일럿 테스트: 신규 에이전트 프로젝트라면 AgentCore의 관리형 하네스를 먼저 시험해보되, 토큰 사용량과 레이턴시를 LangGraph 직접 구현과 병행 측정해 실질적 트레이드오프를 데이터로 확인하라.

- Pre-Exec 가드레일 레이어 도입 검토: AgentDoG의 Pre-Exec Bench(무해 1,001개 + 위험 671개 샘플)를 활용해 현재 하네스의 사전 실행 리스크 탐지 역량을 자체 평가하고, 도구 호출 전 단계에 독립적인 가드레일 레이어를 추가하라.

- CrewAI 사용 팀의 토큰 프로파일링 선행: 월 $5,000 이상의 LLM 비용이 발생하는 팀은 즉시 토큰 프로파일링을 실행해 CrewAI 추상화 오버헤드를 정량화하라. 18% 절감 사례를 참고해 LangGraph 마이그레이션 타당성을 판단하라.

- 에이전트 평가 지표 다각화: 현재 태스크 성공률 단일 지표로만 에이전트를 평가하고 있다면, arXiv 2604.19818의 프레임워크를 참고해 거버넌스 정책 준수율과 도구 안전성을 독립 측정 축으로 추가하는 평가 인프라 개선을 시작하라.

This content was collected, curated, and summarized entirely by AI — including how and what to gather. It may contain inaccuracies. Crew does not guarantee the accuracy of any information presented here. Always verify facts on your own before acting on them. Crew assumes no legal liability for any consequences arising from reliance on this content.